BLOG SEOXAN

Mantente al dia sobre las últimas tendencias en marketing digital y seguridad informática

Categorias

Últimas entradas en el blog

La obligatoriedad del código QR en facturas y tiquets de venta

Fecha: 2025-01-15 21:25:42Autor: Alex Rubio

La normativa española establece que, a partir de mediados del año 2025, será obligatorio incluir un código QR en todas las facturas, incluidas las simplificadas o tiquets de venta. Este requisito, regulado por la Agencia Tributaria Española (AEAT), tiene como objetivo facilitar la trazabilidad y verificación de las facturas, tanto en formato físico como digital.

Especificaciones Técnicas del Código QR

-

Tamaño y Estándares:

- Dimensiones: entre 30x30 mm y 40x40 mm.

- Norma ISO: El QR debe cumplir la norma ISO/IEC 18004:2015.

- Nivel de corrección: Se requiere un nivel M (medio) de corrección de errores.

-

Contenido Obligatorio: El código QR debe incluir una URL con los siguientes parámetros:

- NIF del emisor.

- Número de serie y factura.

- Fecha de emisión en formato DD-MM-AAAA.

- Importe total de la factura con hasta dos decimales, usando un punto como separador decimal.

-

Ubicación en la Factura:

- El código QR debe estar al inicio de la factura, preferiblemente centrado y separado del resto de elementos para asegurar su visibilidad.

- En formatos verticales (A4, por ejemplo), se sitúa próximo al margen superior.

- Debe contar con un espacio en blanco alrededor de al menos 2 mm (preferiblemente 6 mm).

-

Texto Acompañante:

- Justo encima del código debe figurar la etiqueta "QR tributario".

- En facturas verificables, se debe incluir debajo la frase "Factura verificable en la sede electrónica de la AEAT" o "VERI*FACTU".

Normativa Legal

La obligatoriedad del código QR deriva de la normativa que regula los sistemas de facturación, que busca estandarizar procesos y mejorar la transparencia fiscal. Aunque la ley que la establece fue publicada el 5 de diciembre de 2023, su implementación será exigible a partir de mediados de 2025.

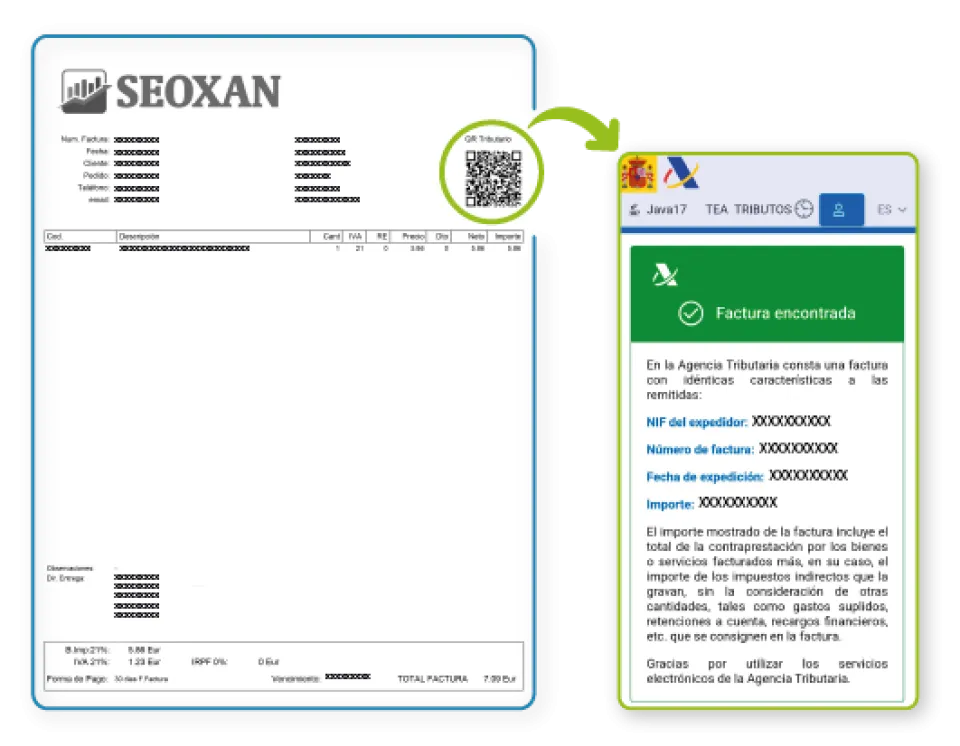

Ejemplos de Implementación

El documento técnico de la AEAT incluye ejemplos detallados sobre el diseño y colocación del código QR, considerando diferentes formatos de facturas y escenarios.

Importancia de la Implementación

El código QR mejora la transparencia fiscal y facilita la gestión tanto para emisores como receptores. Permite verificar la autenticidad de las facturas de manera ágil mediante la sede electrónica de la AEAT.

Consecuencias del Incumplimiento

El incumplimiento de este requisito puede conllevar sanciones administrativas, además de dificultar la validación de las facturas en procesos fiscales, afectando la operatividad de las empresas.

En conclusión, la incorporación del código QR en facturas y tiquets de venta representa un avance significativo en la modernización de los procesos tributarios en España, que segun hacienda beneficia a todos los actores involucrados :-).

Introducción a VERI*FACTU: Qué es y cómo afecta a tu empresa

Fecha: 2025-01-15 18:48:06Autor: Alex Rubio

Introducción a VERI*FACTU: ¿Qué es y cómo afecta a tu empresa?

En este artículo queremos mantenerte informado sobre los cambios normativos que próximamente afectarán a empresas, autónomos y comercios. En concreto, hablaremos del sistema VERI*FACTU, una normativa que marcará un antes y un después en la gestión y emisión de facturas.

Este es el primero de una serie de artículos informativos en los que explicaremos, de manera clara y sencilla, qué es VERI*FACTU, cómo te afecta y qué pasos debes seguir para cumplir con esta nueva obligación. En cada entrega, abordaremos un concepto clave para ayudarte a prepararte de manera práctica y efectiva.

¿Qué es VERI*FACTU?

El término VERI*FACTU es una forma abreviada y coloquial de referirse al reglamento que establece los requisitos para los sistemas informáticos o electrónicos utilizados en los procesos de facturación. Este reglamento fue aprobado mediante el Real Decreto 1007/2023, de 5 de diciembre, y desarrolla el artículo 29.2.j) de la Ley General Tributaria, introducido por la conocida "Ley Antifraude" (Ley 11/2021, de 9 de julio).

El objetivo principal de esta normativa es prevenir, dificultar y detectar posibles fraudes en la facturación mediante la adopción de medidas de seguridad y control. Entre los puntos clave destacan:

-

Resumen de la factura: Los sistemas de facturación deben generar, guardar o enviar a la Agencia Tributaria un registro de facturación con información estructurada y medidas de seguridad como la huella digital de los datos.

-

Trazabilidad: Cada registro debe incluir información del registro anterior para garantizar que no haya omisiones en la cadena de facturación.

-

Código QR: Las facturas emitidas deben incluir un código QR que permita a quien la recibe enviar los datos fácilmente a la Agencia Tributaria para su verificación.

Nota importante

Desde SeoXan, ya estamos trabajando en las adaptaciones necesarias para nuestro programa de facturación AR6 Solución Cloud, un sistema SaaS que incorporará todas las funcionalidades para cumplir con los requisitos de VERI*FACTU. Todos nuestros clientes podrán beneficiarse de estos cambios en los próximos días, asegurando una transición ágil y sin complicaciones.

Si tienes cualquier pregunta o necesitas asesoramiento, no dudes en ponerte en contacto con nosotros.

¿Qué sigue?

En el próximo artículo profundizaremos en cómo afecta VERI*FACTU a las empresas y cuáles son los primeros pasos que debes dar para adaptarte.

Gracias por tu atención y confianza.

Crítica al sistema VERI*FACTU: El empresario bajo constante sospecha

Fecha: 2025-01-09 10:07:49Autor: Alex Rubio

La Agencia Tributaria está implementando un nuevo sistema de control fiscal basado en la factura electrónica, conocido como VERI*FACTU. Aunque la tecnología puede ser una herramienta poderosa para optimizar procesos, este sistema representa una amenaza directa para la libertad y tranquilidad tanto de los empresarios como de los consumidores.

En el sistema tradicional, uno es inocente hasta que se demuestre lo contrario. Sin embargo, con VERI*FACTU, el empresario estará obligado a reportar todas sus facturas en tiempo real, lo que equivale a una inspección fiscal constante y perpetua. Este enfoque implica que Hacienda asume, de manera implícita, que el empresario podría estar cometiendo irregularidades en cualquier momento. Esta desconfianza institucionalizada genera una presión insostenible sobre el tejido empresarial.

Las cargas del empresario: entre impuestos y fiscalización

Ser empresario en España ya conlleva un alto nivel de exigencia. Mantener una plantilla, generar resultados, pagar impuestos elevados y enfrentarse a un sistema que penaliza la retirada de dividendos personales son solo algunas de las cargas habituales. Ahora, con VERI*FACTU, se suma una nueva presión: la de adquirir un software especializado para reportar facturas en tiempo real. Esto supone un coste adicional, especialmente para los pequeños empresarios, que muchas veces luchan por mantenerse a flote en un mercado altamente competitivo.

Pero la situación va más allá de los empresarios. Este sistema también invade la privacidad de los consumidores. Al reportar cada transacción en tiempo real, Hacienda podrá saber con precisión qué compras haces, dónde y cuándo. Por ejemplo, si cenas en un restaurante determinado, esa información quedará registrada y disponible para el Estado. Esta vigilancia constante no solo atenta contra la libertad del empresario, sino también contra la del ciudadano común.

El impacto en los pequeños negocios

La implementación de VERI*FACTU golpea especialmente a los pequeños negocios, que tendrán que adaptarse a estas nuevas exigencias tecnológicas. Muchos de ellos no cuentan con los recursos ni el conocimiento necesario para implementar sistemas de facturación electrónica complejos. Esto podría llevar al cierre de muchos negocios familiares y pymes, reduciendo la diversidad empresarial y concentrando el mercado en manos de grandes corporaciones.

Un país que asfixia a sus empresarios

La situación fiscal en España está llevando a muchos empresarios a tomar decisiones drásticas, como trasladarse a países con menor carga fiscal y menos intervencionismo, como Andorra. La sensación de vivir en un "estado opresivo, fiscalizador y desconfiado" está lejos de ser saludable para la economía ni para la moral colectiva.

¿El costo de la desconfianza?

Es entendible que el Estado busque combatir el fraude fiscal. Sin embargo, cargar sobre los hombros de los empresarios y ciudadanos la sensación de estar constantemente vigilados tiene un alto precio. Esta estrategia no solo erosiona la confianza entre el Estado y sus ciudadanos, sino que también crea un clima hostil que desincentiva la inversión y el emprendimiento.

En lugar de fomentar el crecimiento empresarial y el desarrollo económico, el sistema VERI*FACTU podría terminar sofocando la innovación y expulsando el talento y las iniciativas del país.

Reflexión final

El futuro de la economía española depende de la capacidad de equilibrar el control fiscal con la libertad empresarial y ciudadana. Si las políticas fiscales continúan aumentando la presión sobre los empresarios, no debería sorprendernos que cada vez más personas decidan buscar oportunidades en otros lugares. Y así, el país pierde no solo talento, sino también la confianza de quienes podrían contribuir a su crecimiento.